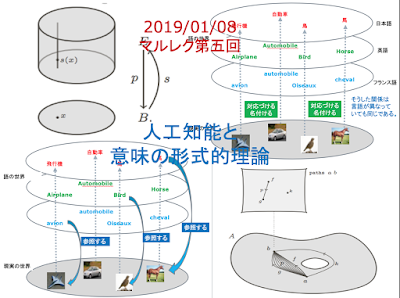

実は、ディープラーニングは数学が理解できないのだ

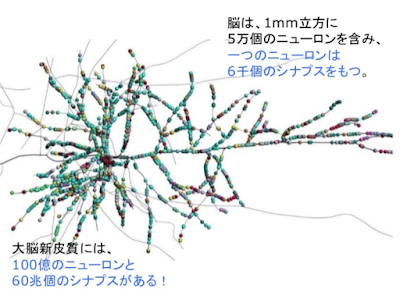

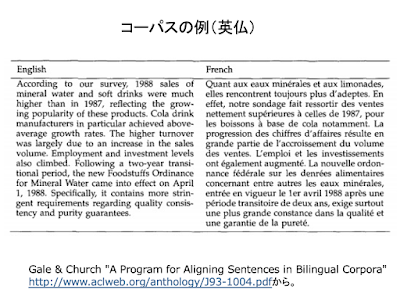

少なくないIT技術者が、人工知能技術の進化は、「ルール中心」から「データ中心」への進化だと思い込んでいる。確かに、「データ中心」のディープラーニング技術が人工知能技術にもたらしたものは、巨大なものだった。それを否定するつもりも、その必要もないもない。 ただ、この何年かの変化だけをみて、人工知能への基本的なアプローチが、「データ中心」のディープラーニング技術で確定し、人工知能技術の未来が、「データ中心」のディープラーニング技術の未来と共にあると考えるなら、それは間違いだ。 明らかに、ディープラーニングには、苦手な領域があるのである。僕は、その一つは、言語の意味理解の能力だと思っているのだが、それについては別の機会に触れる。もっとわかりやすいのは、ディープラーニングの手法で構成された「知能」は、数学を理解することも、数学を学習することもできないということだ。 「人を批判するのはやさしい。 そんなら、自分のアイデアでなんか作って見せてよ。」 もっとも、ディープラーニングは数学ができないという僕が、すらすらと数学の問題を解き、新しい数学の定理を発見する「機械」を作って、皆に見せられるのかというと、そうではないのだ。 「やーい、やーい。 やっぱりできないんじゃないか!」 そうなのだ。でも、子供の喧嘩じゃないのだから、もう少し冷静に議論しようと思う。 今はまだできていないと問題の難しさを認めることは、なんでもできますというよりは、ましなことだ。 大事なことは、「データ中心」と対比されて、エキスパート・システム程度のイメージで「ルール中心」と一把一からげにされてる、論理的・数学的推論を機械に実行させようというもう一つの人工知能技術に、着実で大きな進化があるということである。(RPAの中で、ディープラーニングを「補完」する技術として「ルール・エンジン」が復活しているのだが、僕が、いいたいのはそのことではない。) コンピュータが存在しなかった、今から90年近く前の1930年代、当時まだ若者だったゲーデルやチューリングが発見したことは、「証明可能性」と「計算可能性」が同一の概念だということであった。もう一つの人工知能技術の源流が、そこにある。 ただ、それは数学的・原理的な同一性で、実際のコンピュータに数学の証明をさせるには、いろんな回り道