CLIP -- Contrastive Representation Learning

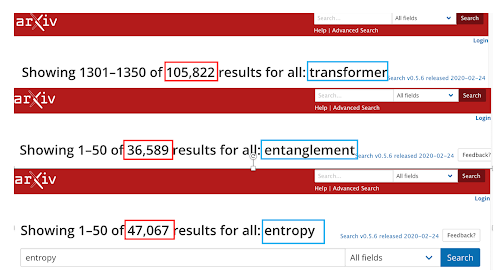

【 「似ているもの」は近くに、「違うもの」は遠くに 】 「テキストとイメージの」結合を目指したOpenAIのプロジェクトCLIPを紹介しています。 これまで、第一に、"natural language supervision" という、ことばで画像の意味を伝えるというアプローチと、第二に、人手によるラベル付は行わず、インターネット上のテキストとイメージのペアを見つけて巨大な訓練用データセットを作ったという話をしてきました。 今回のセッションでは、CLIP ( "Contrastive Language-Image Pre-training" ) という名前の元となった "Contrastive Representation Learning" というCLIP の訓練法を紹介します。 contrastive というのは、日本語の「コントラスト」の形容詞形です。「コントラストのはっきりした」という意味です。"Contrastive Representation Learning" を「対比的表現学習」と訳していいと思います。 この訓練法は、画像認識での定番のCNNの訓練法とも、大規模言語モデルのTransformerの訓練法とも、少し違ったものです。では何故、これらの「実績」のある訓練法ではなく、CLIPは別の訓練法を選んだのでしょう? それは、「最先端のコンピュータビジョン・システムは、非常に大量の計算を使用する。」からです。インターネットから沢山のテキストと画像のペアを集めて、巨大なデータセットを作ったとしても、現実的には計算能力が追いつかないのです。 CLIPが選択した "natural language supervision" は非常に魅力的なアプローチです。ただ、OpenAIのCLIPチームは、いろいろな試行錯誤の中で、このアプローチをスケールさせる成功の鍵は、やはり、その学習効率であることに気づきます。 そこで選択されたのが、"Contrastive Representation Learning" だったのです。 直観的には、対比的表現学習は、比較することによって学習します。何と何を比較するのでしょう? 比較は「似ている」入力のペア(...