5月のセミナーの講演ビデオを公開しました

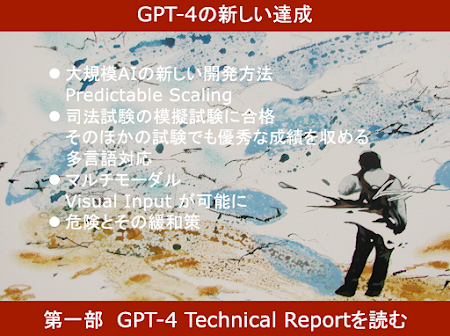

【 5月のマルレク「GPT-4 Technical Report を読む」の講演ビデオと講演資料を公開しました 】 5月に開催したセミナー「GPT-4 Technical Report を読む」は、今年(2023年) 3月に発表されたOpenAIのレポート"GPT-4 Technical Report" を紹介したものです。このレポートは、現在のいわゆる「生成AI」技術の到達点と問題点を知る上で、もっとも基本的なドキュメントの一つだと僕は考えています。 このOpenAIのレポートは、少し奇妙な構成をしています。"GPT-4 Technical Report" と名付けられたレポート本体の「付録 Appendix」に "GPT-4 System Card" という奇妙な名前の別の論文が添付されています。しかもこの付録の文書の方が、本体の文書よりはるかに大きいのです。 問題は、付録の文書の大きさではありません。 この "GPT-4 System Card" は、その冒頭のAbstractで次のように述べます。 「このSystem Cardは、GPTファミリーの最新LLM、GPT-4を解析する。このモデルの限界(微妙に偽りのある説得力のある文章を作成する)と能力(不正なアドバイスを巧妙に提供する、商業的だけでなく軍事的にも両面で性能を発揮しうる、非常時の危険な振る舞いなど)がもたらす安全上の課題を明らかにする。 ・・・ 私たちの緩和策やプロセスは、GPT-4の挙動を変化させ、ある種の悪用を防ぐことができるものの、その効果は限定的で、ある場合には脆いままであることを実証した。これは、先を見越しての計画とガバナンスの必要性を指摘するものである。」 この文書は、GPT-4の脆弱性を「実証」し、さらなる対策の必要性を指摘した重要な文書なのです。残念ながら、この文書の重要性は、あまり広く知られていないように思います。 自分の仕事にとっての生成AIの「能力」にだけ関心のある人が、生成AIが他の分野でもたらす可能性のある「安全性への危険」に大きな興味を持たないのは、ある意味仕方がないことかもしれません。 しかし、その点では、僕は、OpenAIが "GPT-4 Technical Report